Anthropic s’est faire remarquée ces derniers jours en faisant trembler l’action IBM et celles des éditeurs de logiciels de cybersécurité.

D’un côté, Anthropic a expliqué comment l’IA peut automatiser la mise à jour des applications écrites en Cobol, un langage très ancien mais toujours vital pour de nombreuses institutions financières. IBM ne manque jamais une occasion de rappeler que 90 % des transactions financières sont traités par ses mainframes. L’assistant d’Anthropic ne se contente pas de traduire le code ; il analyse les risques, fixe des priorités et vérifie que la nouvelle version fonctionne exactement comme l’originale. Cette annonce a inquiété les investisseurs, entraînant une chute de 13 % de l’action IBM. Les investisseurs ont repris un peu de raison et le cours de l’action est reparti à la hausse vers son niveau antérieur.

D’un autre côté, le lancement de Claude Code Security a semé la panique chez les spécialistes de cybersécurité. Cet outil est capable de scanner des lignes de code pour y débusquer des failles de sécurité complexes et proposer des correctifs aux développeurs. Cette nouvelle concurrence a fait plonger les actions de leaders du marché comme CrowdStrike, Okta ou Palo Alto Networks, avec des baisses allant de 6 % à 10 %.

Pourtant, cette réaction brutale des marchés pose question. Si l’IA d’Anthropic impressionne, ces entreprises de cybersécurité ne sont pas en reste et développent, elles aussi, leurs propres outils d’intelligence artificielle pour protéger leurs clients. Reste à savoir si cette avance technologique d’Anthropic sera durable ou s’il s’agit d’une simple réaction de peur passagère de la part des investisseurs.

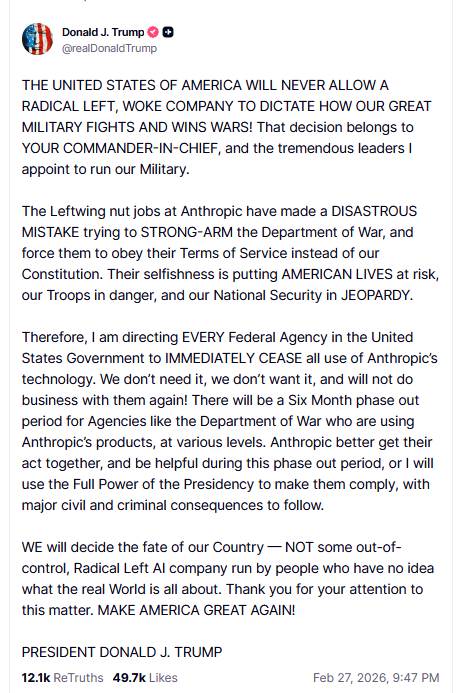

Mais le plus spectaculaire est le bras de fer sans précédent vient d’éclater entre le département de la Défense des États-Unis et la société fondée par des anciens d’Open AI. Au cœur du conflit : le refus de la start-up de supprimer des garde-fous éthiques limitant l’usage militaire de son modèle phare, Claude. La décision vient d’être prise : Donald Trump a donc décidé « le risque pour la chaîne d’approvisionnement » qui interdit à toute entreprise ayant des contrats avec le gouvernement américain d’avoir des relations commerciales avec Anthropic. A commencer par les fournisseurs d’électricité. Anthopic est également disponible sur les 3 hyperscalers (AWS, Microsoft et Google)

Plus tôt cette semaine, le secrétaire à la Défense, Pete Hegseth, a rencontré Dario Amodei, PDG d’Anthropic, pour exiger la levée de deux restrictions majeures imposées à la version de Claude utilisée par le Pentagone : L’interdiction d’utiliser l’IA pour la surveillance de masse des Américains ; L’interdiction d’intégrer l’IA dans des systèmes d’armes totalement autonomes, où la machine prendrait seule la décision de tuer. C’est un peu le monde à l’envers où ce sont les entreprises qui demandent un peu de régulation.

Pete Hegseth a posé un ultimatum clair : sans une capitulation d’Anthropic d’ici vendredi après-midi, le gouvernement pourrait invoquer le Defense Production Act pour prendre le contrôle d’une version modifiée de l’IA, ou classer l’entreprise comme « risque pour la chaîne d’approvisionnement ». Cette dernière sanction, de loin la plus menaçante, habituellement réservée à des firmes étrangères comme Huawei, interdirait de fait toute relation commerciale entre Anthropic et n’importe quel partenaire de l’armée américaine.

Anthropic a officiellement rejeté ces demandes, déclarant ne pas pouvoir « accéder en bonne conscience » aux requêtes du Pentagone. Cette position s’inscrit dans la philosophie de l’entreprise, qui a toujours misé sur la sécurité et l’éthique pour se différencier de concurrents comme OpenAI ou xAI.

Dario Amodei avait d’ailleurs anticipé ce débat sur son site web, affirmant que l’usage de l’IA pour la surveillance à grande échelle ou certaines attaques autonomes devrait être considéré comme un « crime contre l’humanité ».

Cette crise révèle les contradictions de la politique de l’administration Trump vis-à-vis de la technologie :

– Dérégulation vs Contrôle : Alors que le plan d’action pour l’IA de juillet prône le rejet de la « bureaucratie » pour favoriser l’innovation, le Pentagone tente aujourd’hui une manœuvre de nationalisation partielle extrêmement agressive.

– Suspicion vs Dépendance : Le “tsar de l’IA” de la Maison Blanche, David Sacks, a accusé Anthropic de « capture réglementaire » basée sur la peur. Pourtant, l’armée semble juger Claude indispensable, l’IA ayant déjà été utilisée dans des missions critiques, comme celle visant le président vénézuélien Nicolás Maduro en janvier.

Le Pentagone a six mois pour décommissionné l’utilisation des technologies Anthropic et devra donc faire appel à d’autres technologies.

Si Anthropic dispose d’une assise financière solide — avec un chiffre d’affaires annualisé de 14 milliards de dollars et une récente levée de fonds de 30 milliards — une mise au ban par le gouvernement pourrait entraver sa croissance future.

Cette situation pourrait transformer le capitalisme américain en un marché où le succès dépend moins de la qualité du produit que de la « loyauté » affichée envers la Maison Blanche. En attendant, le Pentagone continue de consulter d’autres sous-traitants plus enclins à collaborer sur l’armement autonome, comme Palantir ou les entreprises soutenues par Andreessen

On le constate, la dérégulation a des limites. Une entreprise privée peut faire ce qu’elle mais dans les iimites imposées par le gouvernement. C’est la politique défendue par l’administration en place.